ChatGPT op de korrel genomen

Uit het departement: “Hoge bomen”

De voorbije weken waren er talloze persartikelen die wezen op verschillende problemen rond OpenAI en zijn populaire AI-chatbot ChatGPT. De collega’s van KBC Asset Management zetten de issues op een rij en wat die betekenen voor het bedrijf en diens technologie.

Kwaliteitsproblemen

- Hallucinaties

ChatGPT kan last hebben van "hallucinaties", wat betekent dat het zelfverzonnen of valse informatie kan geven. ChatGPT doet zelfs alsof zijn antwoord correct is terwijl dat niet zo is. - Onjuiste antwoorden

ChatGPT kan een uiterst nuttig hulpmiddel zijn, maar het kan ook totaal foute of onvolledige antwoorden geven. Dit kan te wijten zijn aan de logica of de formulering van de vraag van de eindgebruiker, maar meestal is het gewoon te wijten aan de complexiteit van de vraag van de eindgebruiker. Onderzoekers rapporteerden ook dat veel antwoorden op programmeer-gerelateerde vragen onnauwkeurig waren. - ChatGPT kan dommer worden

Onderzoekers van de Amerikaanse universiteiten Berkeley en Stanford hebben de evolutie van de kwaliteit van de antwoorden van ChatGPT bestudeerd voor de modellen GPT-3.5 en GPT-4. Ze gaven ChatGPT vier opgaven in maart en dezelfde vier opgaven later in juni en vergeleken vervolgens de resultaten. De taken bestonden uit wiskundeproblemen, gevoelige of "gevaarlijke" vragen, het genereren van softwarecode en visueel redeneren. De bevindingen waren dat het gedrag van ChatGPT sterk fluctueert. De prestaties van sommige taken verbeterden van maart tot juni, terwijl ze voor andere taken verslechterden. Met andere woorden, het is waarschijnlijk dat ChatGPT dommer wordt in de loop van de tijd.

Bezorgdheden

- Privacy van gegevens

Over het algemeen maken organisaties zich zorgen over het lekken van bedrijfsgegevens in (1) AI-trainingssets en (2) inferenties. Dit laatste is een risico omdat ChatGPT gesprekken en logs opneemt op zijn servers en deze deelt met andere bedrijven en zijn AI-trainers. Het is dus niet veilig om vertrouwelijke informatie te delen met ChatGPT. OpenAI werkt aan ChatGPT Business en kan mogelijk enkele van de zorgen wegnemen.

ChatGPT heeft ook de mogelijkheid om gebruikt te worden als gezichtsherkenningsmachine. Tot nu toe is deze mogelijkheid uit voorzorg uitgeschakeld. - Auteursrechten

Voor het trainen van grote taalmodellen (LLM) zoals GPT-3.5 en GPT-4 gebruikt OpenAI gigantische trainingsdatasets. Om deze gigantische datasets op te bouwen, gebruikt OpenAI dataschraaptools. Het heeft zelfs een gloednieuwe GPTBot gebouwd, een nieuwe bot voor het crawlen van websites. Het grote probleem is dat informatie waarop auteursrecht rust onrechtmatig in deze gigantische datasets terechtkomt. - Cyberveiligheid

Of het nu in handen is van cybercriminelen of onwetende eindgebruikers, ChatGPT introduceert nieuwe risico's voor cyberbeveiliging. Onwetende eindgebruikers kunnen vertrouwelijke gegevens invoeren in ChatGPT. Ook softwarecode die wordt gegenereerd door ChatGPT valt niet op wat betreft cyberbeveiligingsoverwegingen.

Cybercriminelen kunnen ChatGPT op verschillende manieren misbruiken, bijvoorbeeld voor het maken van malware, voor social engineering-campagnes, om kwetsbaarheden te vinden in API's, enz.

Gevolgen

- De meeste organisaties verbieden ChatGPT

Volgens Blackberry verbiedt 75% van de organisaties het gebruik van ChatGPT voor hun werknemers, voornamelijk op basis van de eerder genoemde zorgen over gegevensprivacy. - Veel rechtszaken op komst

OpenAI kan extra personeel gaan aannemen op de juridische afdeling om alle rechtszaken te behandelen die tegen hen worden aangespannen. Enkele voorbeelden van claims:- OpenAI heeft illegaal boekteksten gekopieerd door geen toestemming te krijgen van auteursrechthebbenden of hen krediet en compensatie aan te bieden.

- ChatGPT en DALL-E verzamelen persoonlijke gegevens van mensen van over het hele internet in strijd met de privacywetgeving.

- GitHub's Copilot (die OpenAI's Codex model gebruikt) is aangeklaagd in een massale rechtszaak voor grootschalige softwarepiraterij. De AI-tool zou de licentierechten schenden van softwareontwikkelaars die hun software onder open source licenties op GitHub plaatsen.

- De New York Times wil haar auteursrecht verdedigen. OpenAI heeft artikelen uit de krant gebruikt om zijn GPT-modellen te trainen.

- Strengere regelgeving op komst

Het gesprek in de VS over AI-beleid en -regulering richt zich op twee belangrijke sporen: 1) consumentenbescherming, gegevensprivacy en burgerrechten, en 2) nationale veiligheid. Aangezien de materie vrij complex is, kost het creëren van een nieuw wetgevend kader tijd en zal het naar verwachting op zijn vroegst in 2024 klaar zijn. De eerder genoemde problemen met hallucinaties, onjuiste informatie, gegevensprivacy, beveiliging, auteursrechtenkwesties en meer zullen allemaal worden aangepakt door dit nieuwe wetgevingskader.

In de EU richt de voorgestelde wetgeving - de Artificial Intelligence (AI) Act - zich vooral op het versterken van de regels rond gegevenskwaliteit, transparantie, menselijk toezicht en verantwoordingsplicht. - Populariteit neemt af

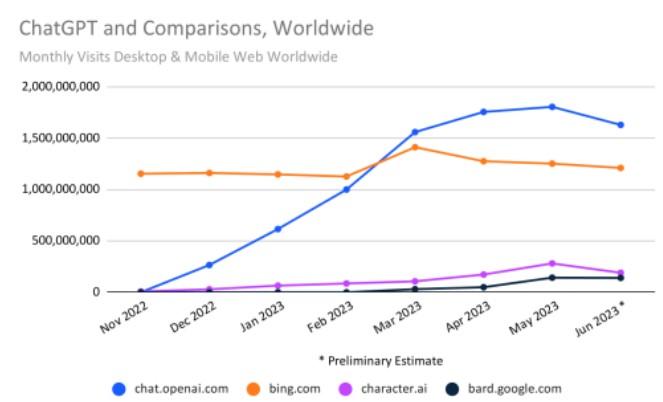

Het mobiele en desktopverkeer naar de website van ChatGPT daalde in juni 2023 wereldwijd met 9,7% ten opzichte van de maand ervoor, volgens internetdatabedrijf Similarweb. Het was de eerste keer sinds de lancering van ChatGPT in november 2022. - Microsoft flirt met het AI-platform van Databricks

Microsoft wil misschien het AI-platform van Databricks aanbieden via zijn Azure-cloud. Als dat echt gebeurt, zal OpenAI's ChatGPT veel momentum verliezen ten voordele van Databricks' AI-aanbod. Er gaan geruchten dat Microsoft niet blij was met de voortijdige lancering van ChatGPT in november 2022. Microsoft had in plaats daarvan de lancering van Bing Chat een paar maanden later gepland, wat de grote doorbraak van generatieve AI moest worden.

Een lange weg te gaan

OpenAI maakt verlies, wat natuurlijk niet ongewoon is voor een start-up. Tot nu toe heeft OpenAI al maar liefst 540 miljoen dollar aan verliezen geslikt sinds de introductie van ChatGPT in november 2022. Gelukkig kan OpenAI nog steeds rekenen op de steun van partner Microsoft. OpenAI moet ongeveer 700.000 dollar per dag betalen om de gratis versie van ChatGPT (gebaseerd op het GPT-3.5 model) draaiende te houden. Eén query kost ongeveer 0,36 dollar. Inferencing - d.w.z. het uitvoeren van die query's - is erg duur. Er zijn betere GPU-chips nodig om deze kosten te verlagen. De inkomsten die worden gegenereerd door de betaalde versie van ChatGPT (gebaseerd op het GPT-4-model) dekken de verliezen niet. Het is dus nog een lange weg voor OpenAI naar winstgevendheid. En de hype is al aan het vervagen.